Genie 3, présenté par Google DeepMind à l’été 2025, est une vraie révolution dans le monde l’IA. Le laboratoire britannique le décrit comme un modèle de monde généraliste, capable de transformer une simple description « Prompt » en environnement photoréaliste que l’on peut explorer en temps réel, comme dans un jeu vidéo.

Depuis, un prototype baptisé Project Genie vient donner un aperçu plus concret. Le 29 janvier 2026, c’est son ouverture à un public plus large qui va pouvoir; créer, modifier et parcourir des univers interactifs à partir d’instructions écrites et parfois d’images, selon les modalités d’accès annoncées.

Un modèle de monde, pas un moteur de jeu

Pour comprendre ce que change Genie 3, il faut d’abord éviter un contresens. Il ne s’agit pas d’un nouveau Unreal Engine, ni d’un outil qui assemblerait des polygones, des textures et des scripts comme le ferait un studio. Genie 3 relève d’une autre logique : celle des world models, ces IA conçues pour simuler un environnement, anticiper son évolution et tenir compte des actions d’un agent.

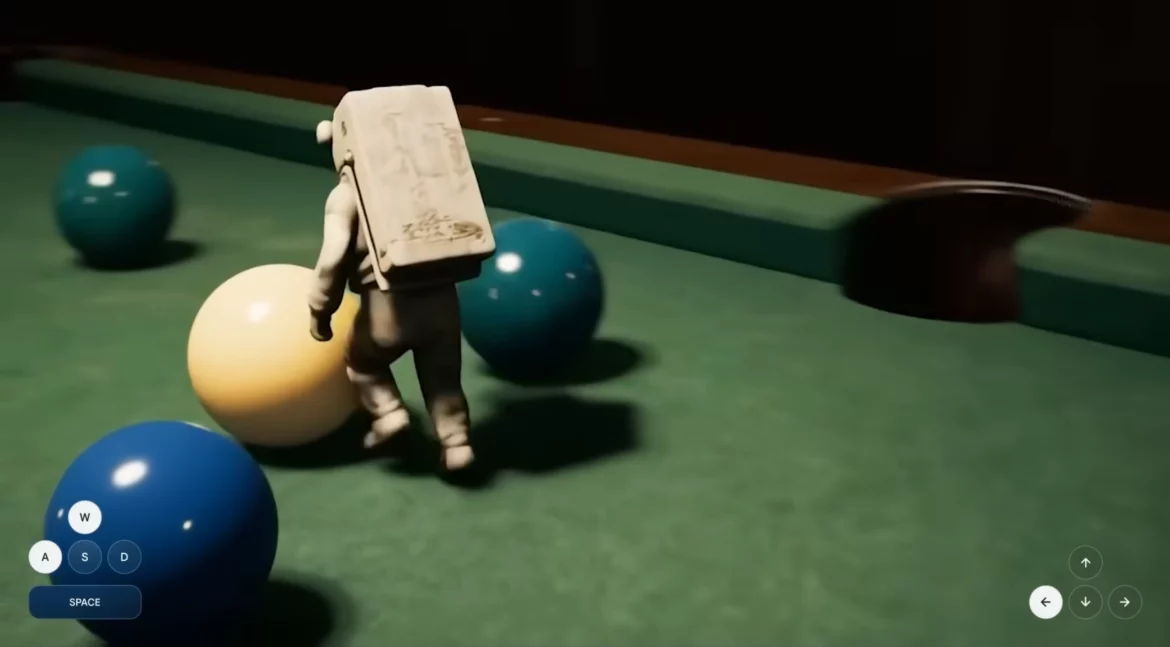

Dans les faits, au lieu de générer un rendu final une bonne fois pour toutes, le système produit le monde image après image, en fonction de la description initiale et de ce que fait l’utilisateur. DeepMind annonce une fluidité comprise autour de 20 à 24 images par seconde, pour un affichage de l’ordre de 720p ( Les puristes des gros FPS en 4K ne vont pas aimer hein!! ). Dit autrement, on n’est pas face à une vidéo que l’on regarde, mais face à une scène qui réagit, un espace où l’on avance, où l’on tourne la caméra, où l’on expérimente.

Du coup, le monde n’existe pas comme un niveau stocké sur un disque dur, il est fabriqué à la volée, en continu, au fil de l’exploration. C’est une idée fascinante, mais aussi terriblement exigeante, car la moindre incohérence saute aux yeux dès que l’on contrôle le mouvement.

La génération d’images est désormais banalisée. La génération de vidéos progresse vite. Mais la génération d’un monde interactif impose une contrainte supplémentaire : la cohérence dans le temps.

Un décor qui se contredit, un objet qui change de forme à chaque détour, une porte qui disparaît dès qu’on se retourne… DeepMind insiste justement sur la capacité de Genie 3 à se souvenir d’éléments déjà vus et à conserver une certaine stabilité pendant plusieurs minutes d’interaction. Dans ses démonstrations, l’environnement supporte des déplacements continus et l’on peut revisiter un endroit en retrouvant des détails attendus, sans que tout ne se réinitialise instantanément.

Cette stabilité reste toutefois limitée. L’équipe parle d’une interaction soutenue sur quelques minutes, avec une mémoire qui peut intégrer des changements liés à des actions récentes sur une fenêtre de l’ordre de la minute. ça reste mieux que sur GTA V , ou il suffit de beaucoup moins pour dire au revoir à sa belle caisse qu’on a laissé à quelque mètres derrière 😉

L’autre concept annoncé par DeepMind porte un nom presque littéraire : les événements pilotables par prompt. Donc, plutôt que de relancer une génération à partir de zéro, l’utilisateur peut demander au monde de changer, par exemple modifier la météo, faire apparaître un élément, transformer l’ambiance, introduire un personnage ou un objet.

Là où un moteur classique demande du temps, des assets, des réglages, Genie 3 promet une forme de montage en direct, comme si l’on réécrivait le décor en pleine scène. Les exemples montrés par DeepMind vont de paysages naturels très réalistes à des univers plus stylisés, jusqu’à des situations proches de la fiction animée.

Les chercheurs s’y intéressent

Genie 3 n’est pas seulement un jouet de démonstration. DeepMind le positionne comme une brique utile à l’entraînement d’agents IA. Car un monde interactif réaliste, même imparfait, peut devenir un terrain d’apprentissage : navigation, prise de décision, planification, compréhension de la physique, adaptation à des événements inattendus.

Le laboratoire relie d’ailleurs Genie 3 à ses travaux sur des agents capables d’évoluer dans des environnements 3D. DeepMind a déjà présenté SIMA, puis SIMA 2, comme des agents généralistes destinés à comprendre des mondes virtuels et à y accomplir des objectifs.Genie 3 sert alors de terrain de test, un moyen de générer rapidement des situations variées, sans devoir tout modéliser à la main.

à manier avec prudence

DeepMind avance aussi des usages plus “grand public” dans l’esprit, sinon dans l’accès immédiat : éducation, exploration d’époques historiques, entraînement à des scénarios complexes, prototypage rapide de scènes interactives.

On imagine facilement un professeur faisant visiter une Athènes antique reconstruite à partir de descriptions, un étudiant explorant des phénomènes météorologiques extrêmes en simulation, ou un créateur indépendant esquissant un concept de jeu en quelques minutes. Ces images font rêver et c’est pour cela qu’il faut garder un regard froid : la technologie reste expérimentale et ses limites sont déjà listées.

DeepMind reconnaît notamment :

- une durée d’interaction encore courte à l’échelle d’un jeu complet

- un contrôle imparfait des personnages et des actions possibles

- une incapacité à reproduire fidèlement des lieux réels avec exactitude

- des difficultés connues pour rendre du texte parfaitement lisible dans l’environnement

Avec Project Genie, Google propose un aperçu plus accessible de cette approche. Le prototype repose sur Genie 3 et permet de construire des mondes en les décrivant, puis de les explorer, de les remixer, de les modifier. Selon les annonces rapportées fin janvier 2026, l’accès est encadré et dépend d’offres et de zones géographiques.

Plus d’infos sur le site Officiel de Google DeepMind