Pendant longtemps, le faux vidéo relevait surtout du canular mal monté ou du trucage grossier. Ce temps est révolu. En quelques mois, les outils de génération vidéo par intelligence artificielle ont franchi un cap spectaculaire. Sur les réseaux sociaux, il devient parfois difficile, même pour un œil averti, de distinguer une séquence authentique d’un contenu fabriqué de toutes pièces.

Le phénomène touche désormais l’information, la publicité, l’arnaque en ligne … Une vidéo n’est plus automatiquement synonyme de vérité. Voilà pourquoi apprendre à repérer les indices d’un contenu artificiel est devenu un réflexe numérique de base que chacun de nous doit avoir.

La première chose à comprendre, c’est qu’une vidéo générée par IA n’est pas forcément entièrement fausse. Elle peut être inventée de bout en bout, mais elle peut aussi mélanger du réel et du synthétique. Un visage peut être remplacé, une voix imitée, des lèvres resynchronisées, ou un décor recréé. C’est cette zone grise qui complique la détection.

Pourtant, malgré les progrès rapides de ces outils, certains signaux restent révélateurs.

Le visage : le premier indice

C’est presque toujours là que le doute commence. Dans une vidéo produite ou modifiée par intelligence artificielle, le visage paraît parfois trop lisse, trop uniforme, un peu trop parfait.

Les yeux, par exemple, peuvent bouger de façon étrange. Le clignement est parfois trop rare, trop artificiel, ou légèrement décalé par rapport à l’expression générale. La bouche, elle aussi, trahit souvent. Quand le mouvement des lèvres ne suit pas exactement les mots prononcés, ou quand le contour semble vibrer légèrement, il y a lieu de se méfier.

Il faut aussi vérifier la lumière. Sur une vraie vidéo, les ombres épousent naturellement les volumes du visage. Dans une séquence générée par IA, les reflets peuvent paraître incohérents, surtout autour du nez, des joues ou du menton.

Les mouvements du corps r

Une vidéo truquée n’est pas seulement une affaire de visage. Le corps aussi peut trahir la fabrication.

Les outils les plus récents savent reproduire des gestes avec une efficacité impressionnante, mais la fluidité parfaite reste difficile à tenir sur toute une séquence. On voit alors apparaître de légers flottements. Une main change subtilement de forme, un bras se déplace avec une rigidité inhabituelle, une posture semble manquer de poids ou de logique physique.

Le problème devient encore plus visible dans les scènes complexes, lorsqu’une personne tourne la tête rapidement, croise les bras, manipule un objet ou se déplace dans un environnement chargé. À ce moment-là, l’intelligence artificielle peut perdre en cohérence. Le corps continue de bouger, mais quelque chose sonne faux.

Les détails secondaires sont rarement secondaires

Quand une vidéo paraît convaincante, il faut quitter le visage et regarder le reste. Le décor, les objets, les vêtements, les membres, les arrière-plans donnent de précieux indices.

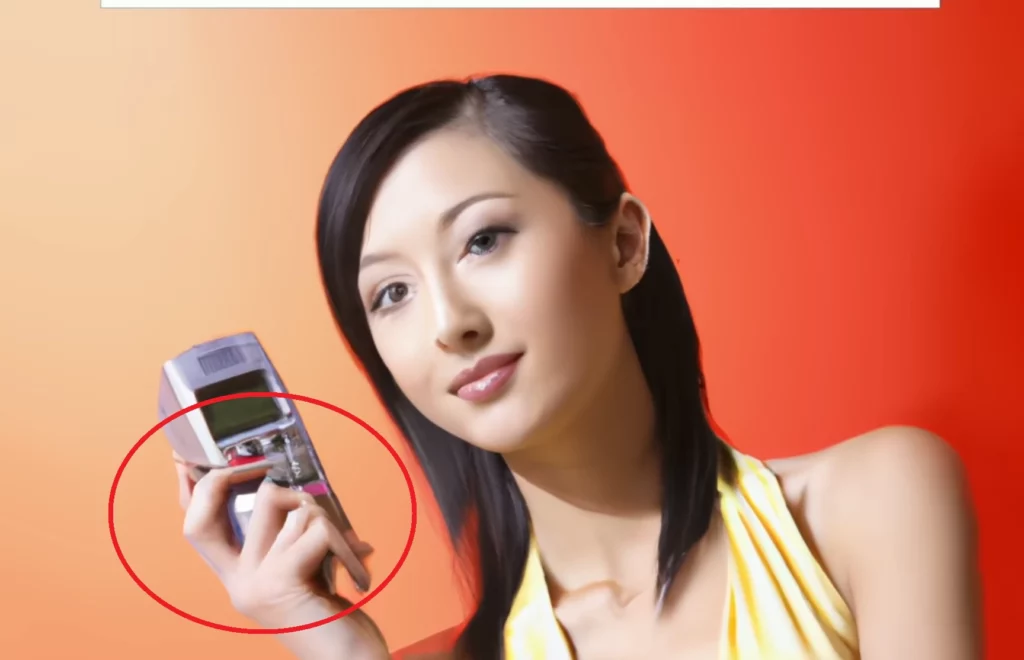

Le texte, par exemple, reste un excellent révélateur. Une affiche, un panneau, une étiquette, un écran de téléphone ou un journal dans le décor peuvent contenir des mots déformés, incomplets ou illisibles. Les intelligences artificielles progressent, mais elles continuent de commettre des erreurs sur les petits éléments graphiques.

Même chose pour les mains, qui restent un point faible bien connu. Doigts trop longs, ou en surplus, proportions bizarres, geste imprécis ou impossible à reproduire dans la réalité, ces défauts ne sautent pas toujours aux yeux au premier visionnage. Mais dès qu’on ralentit la scène ou qu’on fait un arrêt sur image, ils deviennent beaucoup plus visibles.

Les accessoires aussi méritent un examen rapide. Une boucle d’oreille qui disparaît, des lunettes qui changent de forme, une veste dont les plis se réorganisent d’un plan à l’autre, une bague de mariage qui disparait soudainement, tout cela peut signaler une génération artificielle.

Premier indice: Le contexte

Dans de nombreux cas, le premier indice n’est pas visuel. Il est contextuel. Une vidéo sensationnelle publiée par un compte anonyme, sans source identifiable, sans reprise par des médias fiables, doit immédiatement éveiller la prudence. Une séquence qui provoque un choc, une indignation ou une fascination instantanée a précisément plus de chances d’avoir été pensée pour être partagée vite, avant d’être vérifiée.

C’est d’ailleurs le vrai terrain de jeu des deepfakes. Non pas la prouesse technique pure, mais la vitesse de diffusion. Plus un contenu paraît spectaculaire, plus il faut ralentir. Qui publie ? À quelle date ? Dans quel contexte ? Trouve-t-on la même scène filmée sous un autre angle, par une autre source, ou rapportée ailleurs ?

Aujourd’hui, le meilleur réflexe n’est pas technologique. Il est journalistique. Avant de croire, il faut situer.

Le son aussi à examiner

On pense d’abord à l’image, mais la voix peut être tout aussi trompeuse. Une vidéo artificielle peut intégrer un clonage vocal très crédible, par exemple pour imiter une célébrité, un responsable politique, un proche ou un supérieur hiérarchique.

Là encore, plusieurs indices existent. Une voix trop régulière, sans respiration naturelle, avec des intonations légèrement plates ou au contraire exagérées, peut mettre la puce à l’oreille. Parfois, le ton semble juste, mais l’émotion ne colle pas à la situation. Le résultat paraît humain, sans vraiment l’être.

Peut-on encore repérer une vidéo IA à coup sûr ?

La réponse honnête est non. Plus maintenant, en tout cas, pas dans tous les cas. Les spécialistes eux-mêmes reconnaissent que certaines vidéos récentes sont devenues extrêmement difficiles à distinguer de prises de vue réelles, surtout lorsqu’elles sont courtes, vues sur smartphone et noyées dans le flux des plateformes.